Apple và Google đang tiến rất gần đến thỏa thuận hợp tác trị giá 1 tỷ USD/năm, trong đó Apple sẽ sử dụng một phiên bản của mô hình Gemini để vận hành Siri thế hệ mới vào năm tới.

Nhưng điều đáng chú ý hơn cả không phải là giá trị hợp đồng, mà là cách thức Siri sẽ hoạt động “dưới nắp ca-pô” (under the hood) — nơi kiến trúc trí tuệ nhân tạo đóng vai trò quyết định trải nghiệm của hàng trăm triệu người dùng.

Tóm tắt nhanh:

- Siri sắp được “nâng cấp” nhờ mô hình Gemini 1.2 nghìn tỷ tham số từ Google.

- Mô hình này sẽ chạy trên máy chủ riêng của Apple (Private Cloud Compute), đảm bảo quyền riêng tư.

- Dự kiến sử dụng kiến trúc Mixture of Experts (MoE) giúp xử lý nhanh, tiết kiệm năng lượng.

- Chỉ 2–4 “chuyên gia” trong tổng số 32 mạng con được kích hoạt mỗi lần truy vấn, tương đương 75–150 tỷ tham số thực sự hoạt động.

Mô hình 1.2 nghìn tỷ tham số là lớn đến mức nào?

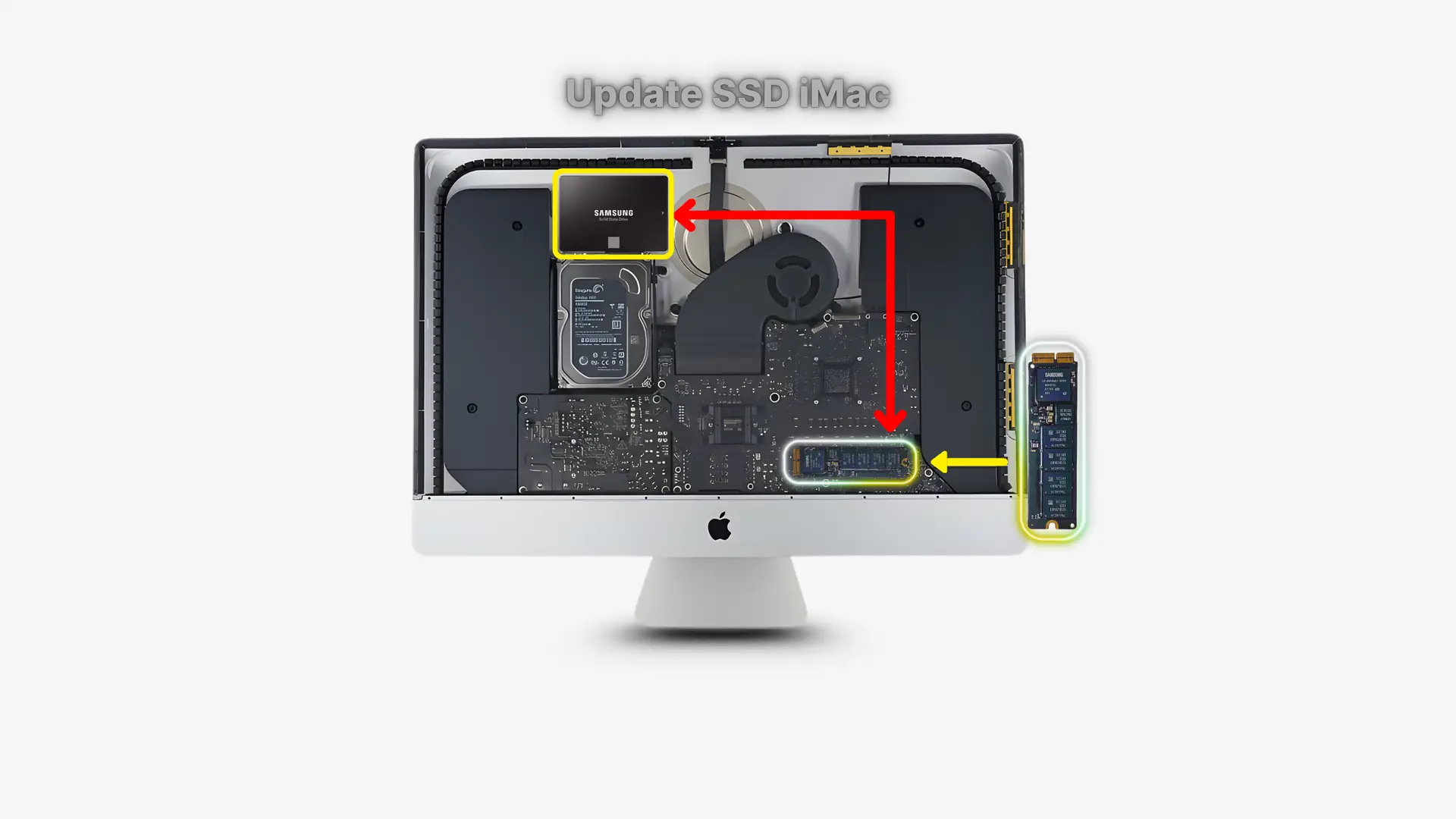

Theo Bloomberg, Google sẽ cung cấp cho Apple một mô hình 1.2 nghìn tỷ tham số, được triển khai trên hệ thống Private Cloud Compute — hạ tầng đám mây riêng bảo mật của Apple.

Điều này đồng nghĩa Google không có quyền truy cập vào dữ liệu hoặc kết quả xử lý của Siri, đảm bảo mức độ riêng tư và bảo mật tối đa.

Về kích thước, đây là một con số ấn tượng. Tuy nhiên, so sánh trực tiếp với các mô hình hàng đầu khác như GPT-5, Gemini 2.5 Pro, hay Claude Sonnet 4.5 lại không dễ, bởi các hãng AI lớn hiện đã ngừng công bố số lượng tham số chính xác.

Giới chuyên môn ước tính hầu hết các mô hình cao cấp hiện nay dao động trong khoảng 1–3 nghìn tỷ tham số — và do đó, Siri dùng mô hình Gemini có thể nằm trong top đầu về quy mô.

“Mixture of Experts” – Kiến trúc đứng sau Siri AI mới

Một điểm nổi bật của mô hình Gemini mà Apple có thể sử dụng là kiến trúc Mixture of Experts (MoE).

MoE là gì?

Đây là kỹ thuật chia nhỏ mô hình lớn thành nhiều mạng con (gọi là experts) chuyên biệt cho từng loại nhiệm vụ.

Với mỗi truy vấn đầu vào, chỉ một vài experts được kích hoạt, thay vì toàn bộ tham số phải hoạt động cùng lúc.

Lợi ích của MoE

- Tốc độ xử lý nhanh hơn, nhờ chỉ kích hoạt phần cần thiết.

- Tiết kiệm tài nguyên, giảm chi phí tính toán so với việc chạy toàn bộ mô hình.

- Hiệu năng cao hơn, vì mỗi expert được huấn luyện sâu cho một nhóm ngữ cảnh cụ thể (ngôn ngữ, hình ảnh, hành vi, lệnh thoại…).

Ví dụ:

Một mô hình có 1.2 nghìn tỷ tham số có thể gồm 32 experts, nhưng chỉ 2–4 experts hoạt động trong mỗi lần truy vấn.

Điều đó có nghĩa chỉ khoảng 75–150 tỷ tham số thực sự được tính toán mỗi lượt — giúp Siri phản hồi nhanh, tiết kiệm năng lượng nhưng vẫn đạt độ chính xác của mô hình “siêu lớn”.

Apple hiện cũng đang áp dụng phiên bản nhỏ hơn của MoE cho các mô hình đám mây hiện tại (khoảng 150 tỷ tham số) — vì vậy việc mở rộng lên 1.2 nghìn tỷ là hoàn toàn khả thi.

Vì sao Siri cần kiến trúc MoE?

- Hiệu năng gấp nhiều lần mà không cần tăng chi phí hạ tầng.

- Cá nhân hóa phản hồi theo ngữ cảnh người dùng (ví dụ: Siri xử lý âm nhạc khác với Siri xử lý lệnh hệ thống).

- Khả năng mở rộng linh hoạt: dễ dàng thêm các “chuyên gia” mới cho lĩnh vực y tế, giáo dục hoặc lập trình mà không phải tái huấn luyện toàn bộ mô hình.

- Giữ quyền riêng tư: dữ liệu người dùng không rời khỏi hệ thống của Apple, ngay cả khi sử dụng công nghệ từ Google.

Liệu Siri có bắt kịp ChatGPT và các đối thủ?

Mặc dù Apple và Google chưa tiết lộ chi tiết kỹ thuật, giới phân tích cho rằng MoE là giải pháp duy nhất khả thi để vận hành một mô hình quy mô nghìn tỷ tham số hiệu quả trên hạ tầng riêng.

Tuy nhiên, câu hỏi đặt ra là:

Liệu 1.2 nghìn tỷ tham số có đủ để Siri cạnh tranh với các đối thủ như GPT-5 hay Gemini 3.0 vào thời điểm ra mắt chính thức năm 2026?

Điều đó còn phụ thuộc vào khả năng tinh chỉnh (fine-tuning) và cách Apple tích hợp Private Cloud Compute với thiết bị người dùng — một hướng đi kết hợp giữa AI đám mây và AI trên thiết bị (on-device) mà hãng đã theo đuổi nhiều năm qua.

Video tham khảo: Cách hoạt động của Mixture of Experts (MoE) do IBM thực hiện.

FAQ – Câu hỏi thường gặp

1. “Mixture of Experts” (MoE) là gì?

Đó là kỹ thuật chia nhỏ mô hình AI lớn thành nhiều “chuyên gia” độc lập; chỉ kích hoạt một số phần khi cần để tăng tốc và tiết kiệm năng lượng.

2. Vì sao Apple chọn Google Gemini cho Siri?

Vì Gemini có quy mô lớn, hỗ trợ đa mô hình (ngôn ngữ, hình ảnh, video) và tương thích cao với Private Cloud Compute của Apple.

3. 1.2 nghìn tỷ tham số có nghĩa là gì?

Là số lượng biến số trong mô hình – càng nhiều tham số, mô hình càng có khả năng “hiểu và phản hồi” tốt hơn, nhưng đòi hỏi công suất tính toán lớn.

4. Siri mới có an toàn về quyền riêng tư không?

Có. Toàn bộ xử lý sẽ diễn ra trên máy chủ riêng của Apple, Google không có quyền truy cập dữ liệu người dùng

5. Khi nào Siri “Gemini-powered” ra mắt chính thức?

Dự kiến năm 2026, cùng với iOS 27 và macOS 27